分割一切、3D重建一切还不够,Meta开源SAM Audio分割一切声音

分割一切、3D重建一切还不够,Meta开源SAM Audio分割一切声音继 SAM(Segment Anything Model)、SAM 3D 后,Meta 又有了新动作。

搜索

搜索

继 SAM(Segment Anything Model)、SAM 3D 后,Meta 又有了新动作。

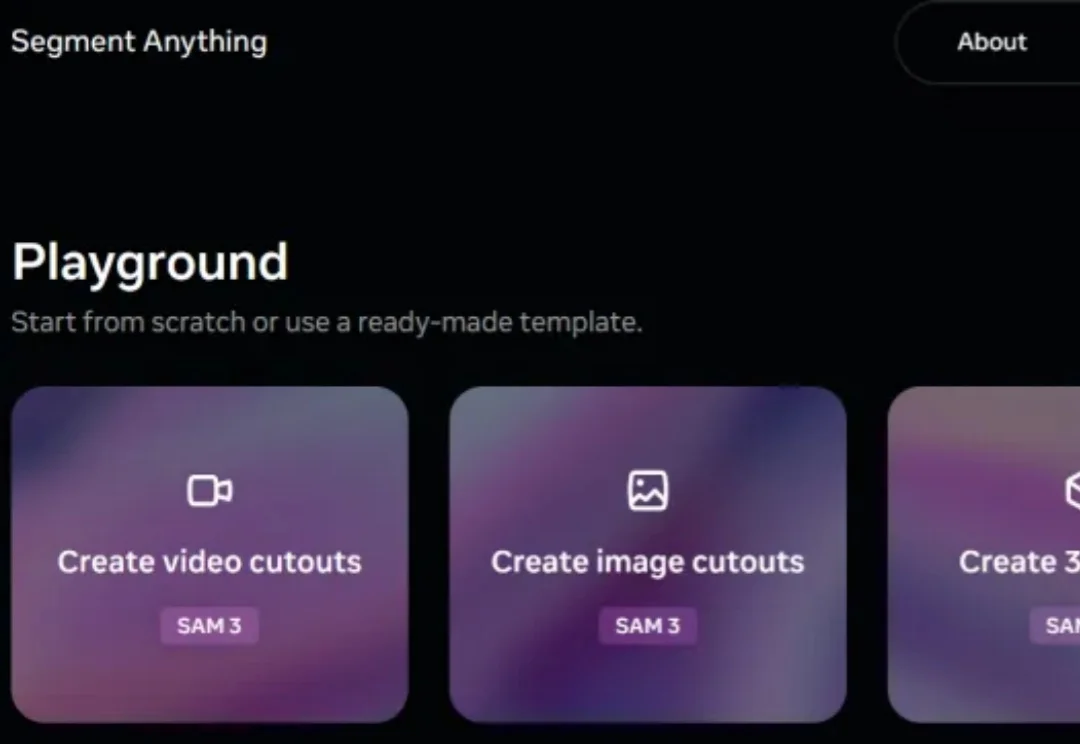

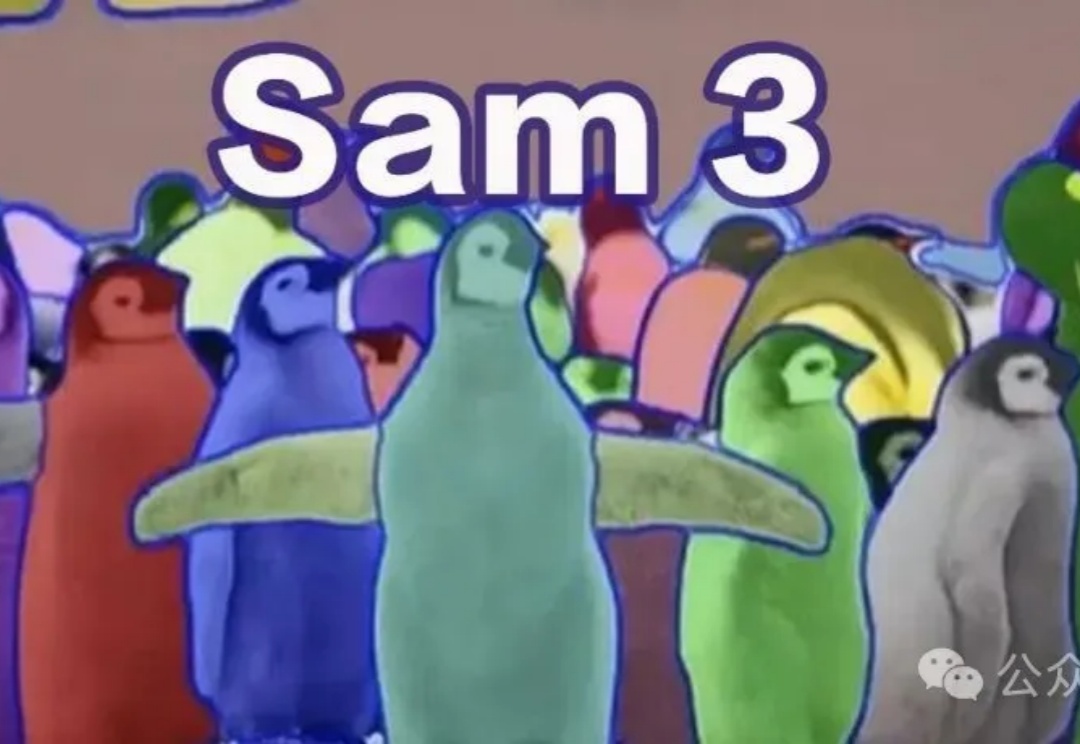

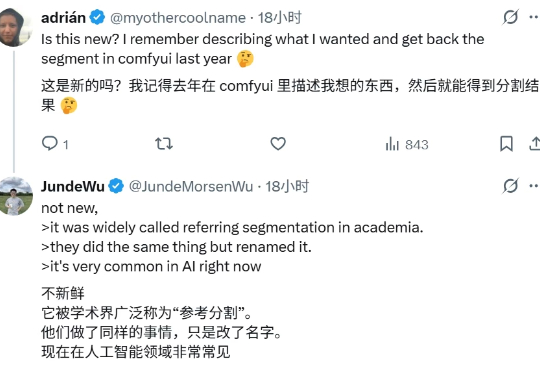

2023年Meta推出SAM,随后SAM 2扩展到视频分割,性能再度突破。近日,SAM 3悄悄现身ICLR 2026盲审论文,带来全新范式——「基于概念的分割」(Segment Anything with Concepts),这预示着视觉AI正从「看见」迈向真正的「理解」。

说出概念,SAM 3 就明白你在说什么,并在所有出现的位置精确描绘出边界。 Meta 的「分割一切」再上新? 9 月 12 日,一篇匿名论文「SAM 3: SEGMENT ANYTHING WITH CONCEPTS」登陆 ICLR 2026,引发网友广泛关注。

Meta的视频版分割一切——Segment Anything Model 2(SAM 2),又火了一把。

Segment Anything Model 2(SAM 2)在传统视频目标分割任务大放异彩,引起了众多关注。然而,港中文和上海 AI Lab 的研究团队发现 SAM 2 的贪婪选择策略容易陷入「错误累积」的问题,即一次错误的分割掩码选择将影响后续帧的分割结果,导致整个视频分割性能的下降。这个问题在长视频分割任务中显得更加严重。

第一个针对「Segment Anything」大模型的域适应策略来了!相关论文已被CVPR 2024 接收。

日前脸书母公司Meta AI实验室推出了一个强大人工智能图像分割软件Segment Anything,可以用自动识别哪些图像像素属于一个对象,并且对图像中各个对象进行自动风格等,可广泛用于分析科学图像、编辑照片等。